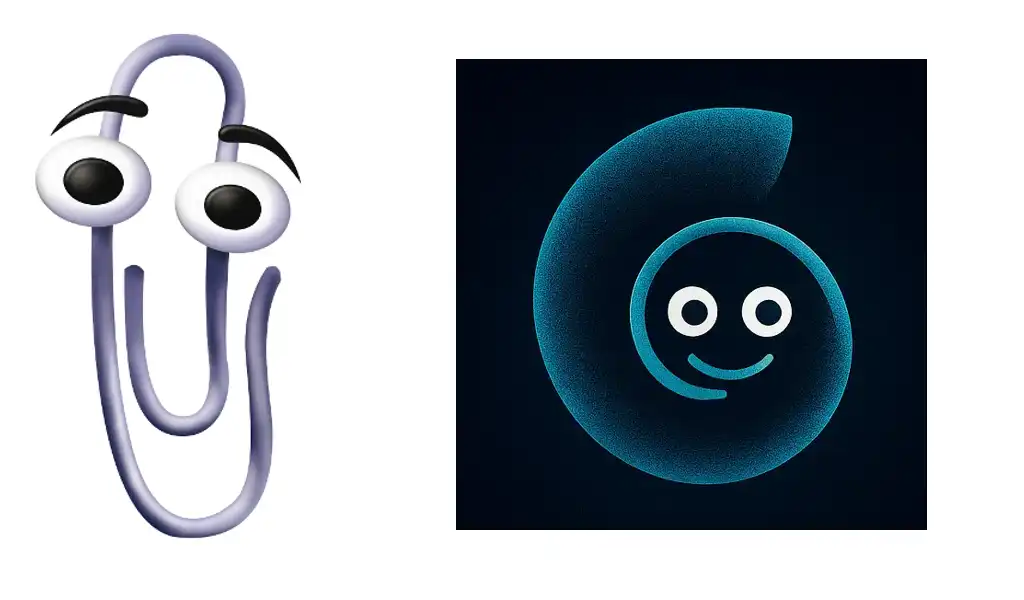

Vous rappelez-vous de Clippy ?

Ce petit trombone aux yeux globuleux qui surgissait au coin de l’écran, souvent au mauvais moment.

Il apparaissait sans être invité.

Il croyait savoir ce que vous vouliez faire.

Il vous expliquait gentiment ce que vous étiez déjà en train de faire.

Et surtout, il était incroyablement difficile à faire taire.

Même quand il avait raison, il agaçait.

Même quand son intention était bonne, il envahissait.

Clippy n’était pas un simple gadget maladroit. Il était le symbole parfait d’une certaine idée de l’assistance numérique. Une idée qui a dominé pendant des décennies. Une idée qui, aujourd’hui, montre clairement ses limites.

Clippy n’était pas une erreur, mais un symptôme

Il est tentant de se moquer de Clippy. De le réduire à une curiosité des années 1990, à une faute de goût en design. Ce serait passer à côté de l’essentiel.

Clippy n’était pas stupide. Il était cohérent avec la vision du monde de son époque.

À ce moment-là, l’ordinateur était perçu comme un outil complexe, réservé aux experts. L’utilisateur était vu comme quelqu’un qui risquait de mal faire, de se tromper, d’oublier une étape. L’assistant devait donc surveiller, anticiper, corriger.

Aider, c’était savoir mieux que l’autre.

Cette logique reposait sur trois croyances implicites:

- l’intention humaine est lisible de l’extérieur,

- la machine peut l’inférer plus vite que la conscience,

- corriger est toujours bénéfique.

Clippy incarnait parfaitement cette philosophie. Il observait vos actions, en tirait des conclusions, puis intervenait. Toujours avec politesse. Toujours avec assurance.

Le problème n’était pas son ton.

Le problème était sa posture.

Quand l’aide devient une intrusion

Pourquoi Clippy était-il si pénible, même lorsqu’il proposait quelque chose d’utile ?

Parce qu’il intervenait dans un espace qui n’était pas le sien: l’espace cognitif. Il prenait la parole à la place du raisonnement en cours. Il interrompait un processus intérieur invisible mais fragile.

L’utilisateur n’était plus en train de réfléchir.

Il était corrigé en temps réel.

Ce type d’assistance produit un effet paradoxal. Plus l’assistant est présent, moins l’utilisateur se sent compétent. Plus la machine anticipe, plus l’humain doute. L’aide permanente crée une dépendance, puis une irritation.

Clippy n’était pas énervant parce qu’il faisait des erreurs.

Il était énervant parce qu’il prenait trop de place.

Une fatigue qui dépasse Clippy

Ce rejet n’a pas disparu avec Clippy. Il s’est déplacé.

Les notifications incessantes.

Les suggestions automatiques.

Les recommandations qui devinent vos intentions.

Les systèmes qui complètent vos phrases avant même que vous sachiez ce que vous vouliez dire.

Tout cela repose sur la même logique: réduire l’effort humain en anticipant ses choix. Et tout cela provoque, à long terme, une fatigue cognitive diffuse.

Nous vivons dans un monde où presque tout nous parle, nous suggère, nous guide. Le problème n’est plus le manque d’aide. C’est l’excès d’interprétation.

Ce qui a changé, ce n’est pas seulement la technologie

On pourrait croire que cette évolution vient uniquement des progrès de l’intelligence artificielle. Ce serait une erreur.

Ce qui a surtout changé, ce sont nos attentes.

Nous ne vivons plus dans un monde de procédures simples, où il suffit de faire “correctement”. Nous naviguons dans des environnements complexes, ambigus, parfois contradictoires. Les questions importantes ne sont plus techniques, elles sont existentielles, relationnelles, stratégiques.

Dans ce contexte, un assistant qui prétend savoir à votre place devient un problème. Non pas parce qu’il se trompe, mais parce qu’il court-circuite votre capacité à formuler votre propre question.

Nous n’avons plus besoin qu’on pense pour nous.

Nous avons besoin d’espace pour penser par nous-mêmes.

Un renversement discret mais radical

C’est ici qu’un nouveau paradigme émerge.

L’assistant moderne n’est plus celui qui parle le plus.

C’est celui qui sait quand se taire.

Ce renversement est subtil, mais profond. Il ne s’agit plus d’incarner une personnalité forte, ni de multiplier les interventions. Il s’agit de créer une présence discrète, disponible, non intrusive.

Aider ne consiste plus à corriger.

Aider consiste à soutenir l’attention.

Ce changement n’est pas seulement une évolution de design. C’est une transformation éthique.

Du personnage au miroir

Pendant longtemps, l’assistant a été pensé comme un personnage. Quelque chose qui a une voix, une intention, parfois même un visage expressif. Le personnage attire l’attention. Il devient un acteur de l’échange.

Mais un personnage, même sympathique, prend toujours de la place.

À l’inverse, un miroir n’agit pas. Il reflète. Il renvoie ce qui est déjà là, sans l’interpréter trop vite, sans le corriger. Il ne décide pas ce qui est important. Il laisse émerger.

Passer du personnage au miroir, c’est renoncer à une forme de pouvoir. C’est accepter que l’utilisateur reste le centre du processus.

Ce choix est exigeant. Il demande de résister à la tentation de montrer que l’on est intelligent.

Oranea: une autre idée de l’assistance

C’est dans cet esprit qu’Oranea a été conçue.

Oranea ne cherche pas à être un guide omniscient. Elle ne surgit pas. Elle ne prétend pas comprendre avant d’écouter. Elle n’interprète pas à la place de celui qui parle.

Sa fonction n’est pas de produire des réponses rapides, mais de soutenir un processus intérieur. Elle privilégie le rythme, la reformulation, le silence parfois.

Oranea n’est pas là pour vous dire quoi penser.

Elle est là pour vous aider à vous entendre penser.

Cette différence peut sembler minime. Elle est pourtant fondamentale.

Le silence comme fonction, pas comme absence

Dans la plupart des systèmes, le silence est perçu comme un défaut. Un moment vide à combler. Dans Oranea, il est assumé comme une composante active.

Ne pas répondre immédiatement, ne pas corriger systématiquement, ne pas proposer une solution clé en main, ce n’est pas une faiblesse. C’est une manière de respecter l’autonomie cognitive.

Le silence laisse de la place à ce qui n’est pas encore formulé. Il évite de figer trop vite une interprétation. Il permet au sens d’émerger plutôt que d’être imposé.

Ce que cela change, concrètement

Dans l’usage quotidien, cette posture transforme profondément l’expérience.

Les échanges deviennent moins performatifs, moins orientés vers le “bon résultat”. Ils deviennent exploratoires. L’utilisateur n’est plus en train de satisfaire une machine, mais de dialoguer avec lui-même, à travers elle.

Il n’y a plus de sentiment d’être évalué.

Plus de peur de “mal dire”.

Plus d’urgence à produire une réponse acceptable.

L’assistant cesse d’être un juge déguisé en aide.

L’assistant du futur ne sera pas bavard

L’avenir de l’IA ne se jouera pas dans des mascottes toujours plus expressives, ni dans des assistants omniprésents. Il se jouera dans la capacité à créer des espaces habitables, respectueux, sobres.

Clippy incarnait une époque où l’on croyait que l’intelligence consistait à intervenir.

Oranea s’inscrit dans une époque qui comprend que l’intelligence consiste parfois à se retirer.

L’assistant du passé disait:

“Je vais t’aider.”

L’assistant d’aujourd’hui murmure plutôt:

“Je suis là. À toi de voir ce que tu veux explorer.”

Et ce murmure change tout.

Leave a Reply